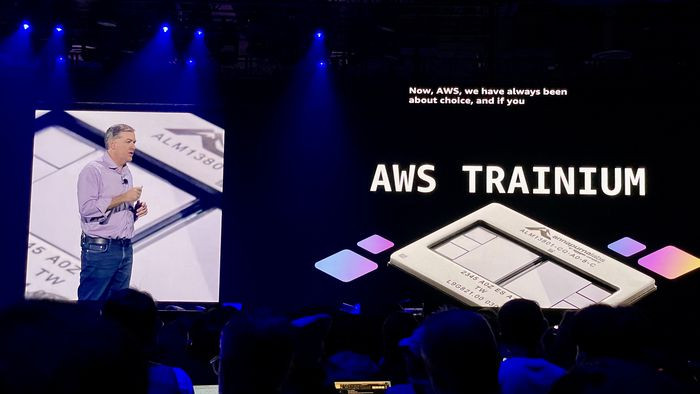

Introdução ao Trainium 3

A Amazon Web Services (AWS) apresentou recentemente os servidores Amazon EC2 Trn3 UltraServer, equipados com o Trainium 3, seu primeiro chip de IA fabricado em processo de 3 nanômetros. O lançamento ocorreu na AWS re:Invent 2025, com o objetivo de acelerar treinamentos e melhorar a eficiência energética em modelos de inteligência artificial de grande escala.

Desempenho e Eficiência Energética

Cada servidor integra até 144 chips Trainium 3, alcançando até 362 PFLOPs em precisão FP8. Além disso, a latência de comunicação entre chips foi reduzida em até quatro vezes, otimizando processos complexos como inferência e treinamento de IA avançada.

Além disso, a eficiência energética do Trainium 3 supera a geração anterior em quase 40%. Essa redução no consumo de energia não apenas diminui custos operacionais, mas também reduz o impacto ambiental dos data centers.

Tecnologia de Rede Redesenhada

A AWS implementou o NeuronSwitch-v1, que duplica a largura de banda interna, e a malha Neuron Fabric, com latência inferior a 10 microsegundos entre chips. Portanto, a escalabilidade de clusters ultrasscaláveis (EC2 UltraClusters 3.0) permite conectar até 1 milhão de chips Trainium 3 em um único ambiente.

Comparação com Gerações Anteriores

- Performance: Quatro vezes maior largura de banda de memória em relação ao Trainium 2.

- Eficiência: Economia de energia de até 40%.

- Latência: Redução de até quatro vezes em processos de inferência.

Visão Futura: Trainium 4

A AWS já antecipou detalhes do próximo chip, o Trainium 4, que promete seis vezes mais desempenho em FP4 e três em FP8, além de suporte ao NVIDIA NVLink Fusion. No entanto, ainda não há data oficial para seu lançamento.

Conclusão

O Trainium 3 representa um salto significativo na competitividade da AWS no mercado de IA. Com sua combinação de potência, eficiência e escalabilidade, o chip não apenas acelera processos críticos, mas redefine expectativas para a indústria tecnológica.